La naturaleza ha servido como inspiración para inventos, un ejemplo de ello fue el aeroplano, en donde los hermanos Wright fueron los primeros en realizar vuelos tripulados y motorizados en los cielos de Estados Unidos y basaron su invento en los vuelos de las aves.

Con esta misma observación de la naturaleza nace la inspiración de construir una máquina inteligente y esto abre la idea de las redes neuronales ANNs (Artificial Neural Networks). Las redes neuronales son los elementos principales del Deep Learning y han ido evolucionando a través de tiempo.

El término ANNs fue introducido por primera vez en 1943 por el neurofisiólogo Warren McCulloch y el matemático Walter Pitts. En su artículo “A Logical Calculus of Ideas Immanent in Nervous Activity”, McCulloch y Pitts presentaron un modelo computacional simple de cómo las neuronas biológicas podrían trabajar juntas en cerebros de animales para realizar cálculos complejos utilizando lógica proposicional.

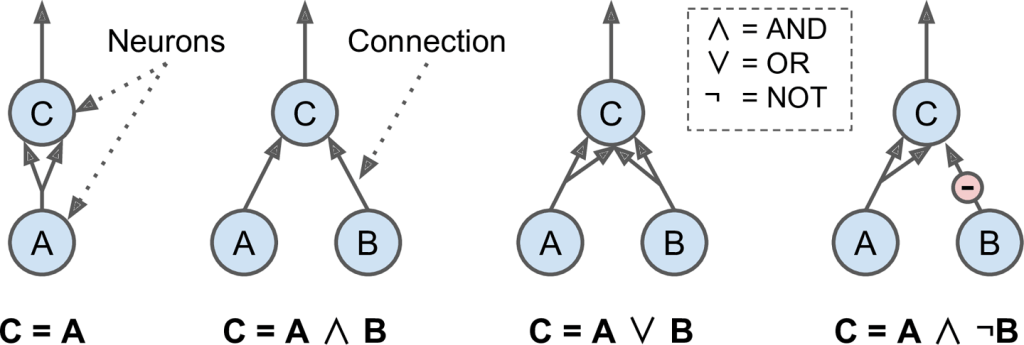

Warren McCulloch y Walter Pitts propusieron un modelo simple de la primera neurona artificial, con una o más entradas y salidas binarias (on/off).Este modelo activa las salidas cuando un número específico de entradas son activadas.

Ahora es fácil imaginar que al combinar estos modelos simples podemos computar expresiones lógicas más complejas.

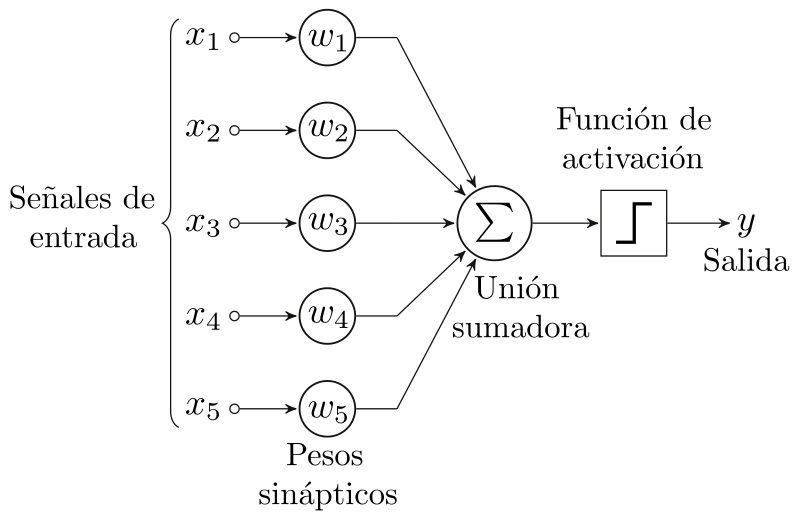

Perceptron es otra de las arquitecturas más simples ANN, inventada en 1957 por Frank Rosenblatt, un modelo ligeramente diferente, denominda LTU (Linear threshold unit). En este modelo las entradas y salidas (inputs / outputs) son números en lugar de valores binarios y cada entrada es asociada a un peso (weight).

Comprender la historia de la redes neuronales es importante, pues ello nos dará las herramientas necesarias para emplearlas y aplicarlas. Tendremos que aprender sobre estructuras de datos, teoría de grafos, probabilidad y estadística, lógica proposicional, calculo y para su aplicación lenguajes de programación: python considerada la lengua franca o R. Existen librerías como TensorFlow o Scikit Learn, pero dependerá de los frameworks que eligas, cada uno con ventajas y desventajas, que más adelante analizaremos.

La combinación de muchas arquitecturas LTU de Perceptron pueden llegar a formar una nueva llamada Multi-layer perceptron, esta formada de muchas capas y pueden aprender de distintas maneras, probablemente más adelante veamos cada una de estas a fondo y una breve aplicación, por ahora solo era tener un conocimiento general de la redes neuronales y su historia.

Escrito por Irving Ariel Escamilla Jacobo